调参

1. 调什么参数

1 训练层面

0 权重初始化

1 学习率

2 batch size

3 epoch

4 dropout

5 正则化

6 优化算法

2 模型层面

1 激活函数

2 网络尺寸

2. 超参数怎么调

1.手动调参

经验值

2.自动化调参

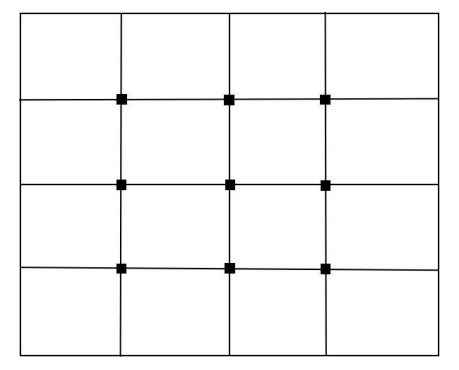

a.网格搜索

超参数排序组合,如果有n个参数,每个参数都有m个候选值,那么网格搜索中就要训练m的n次方个模型。

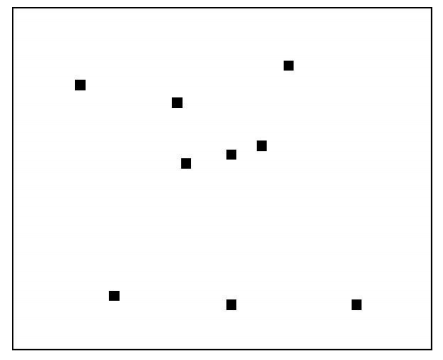

b.随机搜索

比起网格搜索:1、搜索次数少,快 2. 因为有偶然性,可能不是最优

c.贝叶斯优化

https://zhuanlan.zhihu.com/p/146633409

Bayesian optimization algorithm,简称BOA

网格搜索和随机搜索,每次都是相互独立的,贝叶斯优化利用之前已搜索点的信息确定下一个搜索点

参考

https://zhuanlan.zhihu.com/p/340578370

https://www.jianshu.com/p/92d8943fb0ba

https://zhuanlan.zhihu.com/p/146633409

https://blog.csdn.net/weixin_45884316/article/details/109828084

# Related Post

1.内存/显存不够

2.early stop

3.训练,验证同步进行

4.调节学习率

5.权重初始化

6.Gradient Accumulation

7.loss不下降的解决方法

8.优化算法

1.内存/显存不够

2.early stop

3.训练,验证同步进行

4.调节学习率

5.权重初始化

6.Gradient Accumulation

7.loss不下降的解决方法

8.优化算法